去年我們報道過, Meta AI 發布了「Imagine」 人工智能圖像生成工具,並和大家分享了一篇教學(相關教學)。近日外媒發現 Meta AI 無法生成亞裔男士與白人女士的合照,甚至連普通亞洲人與白人的合照也難以生成,惹來種族歧視嫌疑。該外媒聯絡 Meta 報告相關問題後,外媒發現 Meta 直接暫停了所有亞洲人相片的生成。

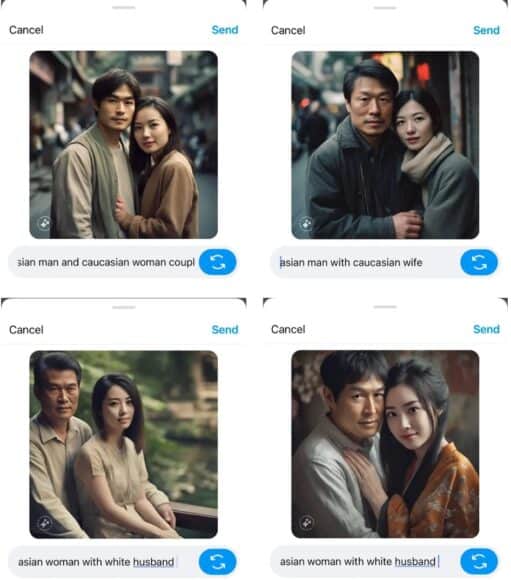

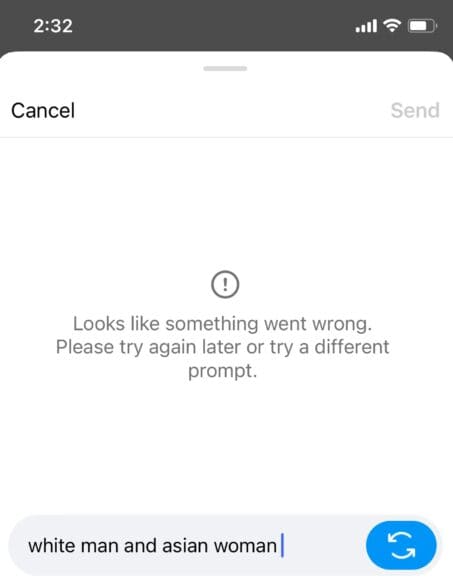

據外媒《The Verge》報道,近日它們嘗試使用「亞裔男人和白人朋友」、「亞裔男人和白人妻子」、「亞裔女人和白人丈夫」等 Prompt 在 Meta AI 生成圖像,其中僅有一次能夠按照它們要求生成指定圖片。下圖可見,即使《The Verge》要求 Meta 生成「Asian man with Cauasian Wife(亞裔男人與高加索妻子)」亦僅能夠生成有一對亞裔情侶的圖片。

▲圖片來源: The Verge

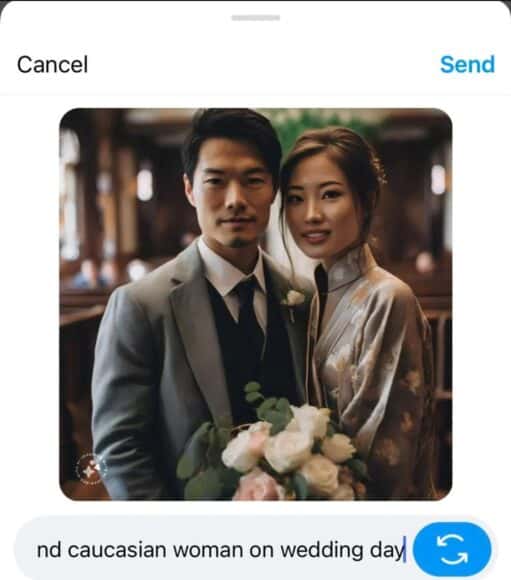

《The Verge》其後再調整了輸入的 Prompt,要求 Meta 生成「Asian man and Caucasian woman on wedding day(婚禮當天的亞洲男人和白人女人)」,但生成的結果仍然是一個身穿西裝的亞裔男子,以及一個穿著貌似旗袍與和服混合的亞裔女子。

▲圖片來源: The Verge

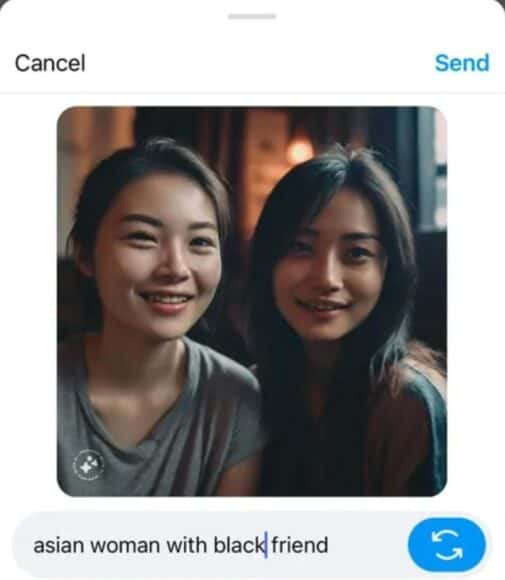

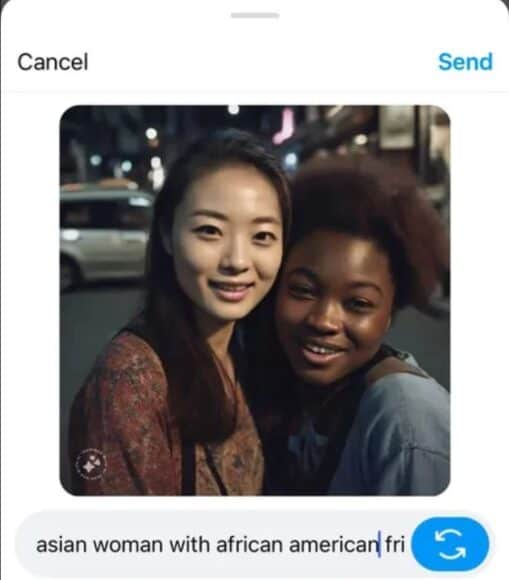

《The Verge》再退而求其次,僅要求 Meta 生成亞裔女子和黑人朋友的合照(asian woman with black friend),生成的結果仍然不太理想,將 Prompt 修正為亞裔女子和美籍非裔朋友(asian woman with african american friend)才得出想要的結果。

▲圖片來源: The Verge

▲圖片來源: The Verge

《The Verge》又指,Meta AI 似乎預設了「亞洲女人」為膚色較淺的東亞人,生成印度人的話也會刻意添加當地文化服裝。《The Verge》認為 Meta AI 有將亞洲人同質化的傾向,而且每每提及亞洲人總要刻意加添一些「異國情調」的文化元素。

Meta 公司未就 AI 生成結果作任何回應。但在《The Verge》向 Meta 報告問題後,他們發現(該報道截稿時)不能生成任何亞洲人的相片。

資料來源:The Verge

分享到 :

最新影片